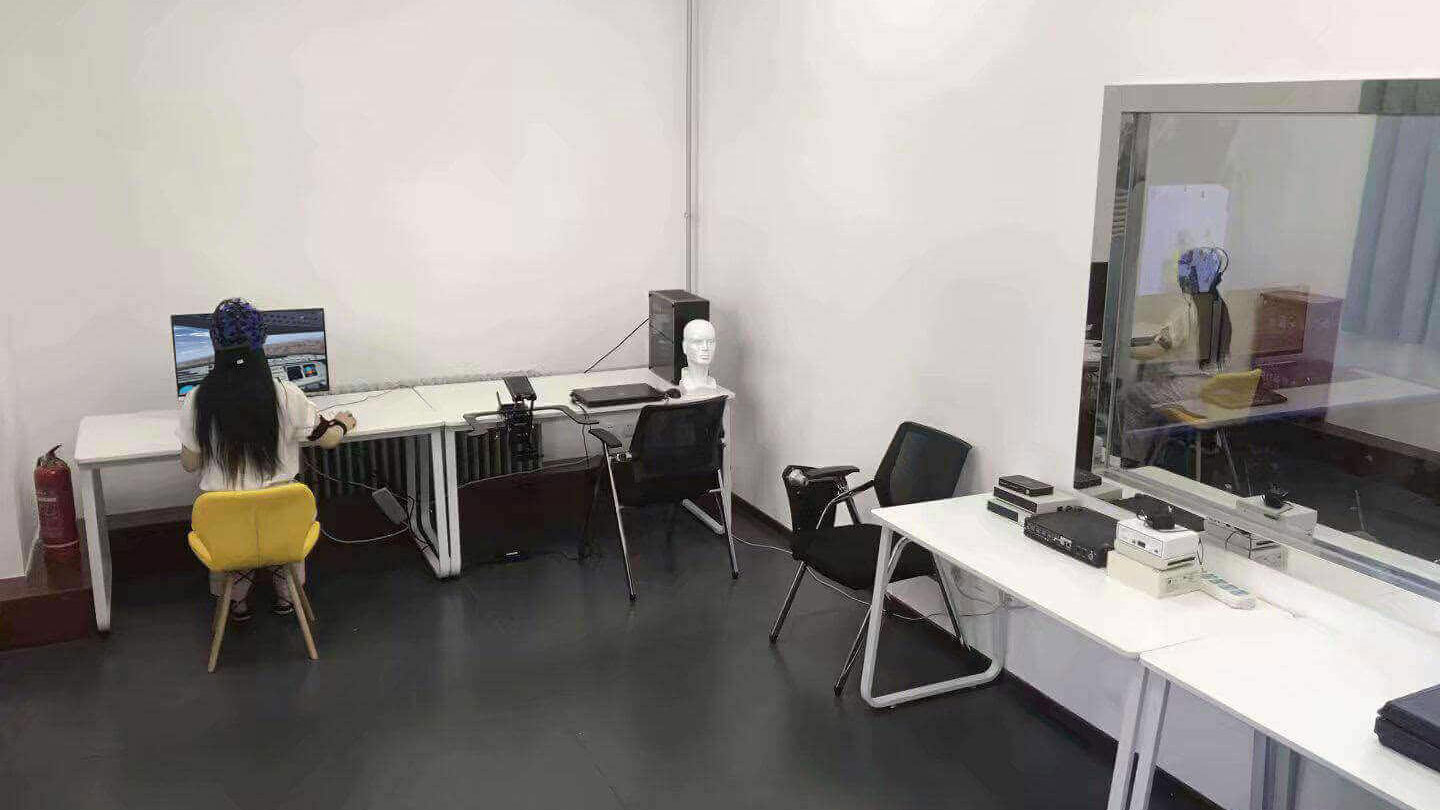

ErgoLAB Behavior行為觀察分析模塊,采用標(biāo)準(zhǔn)攝像頭錄制行為視頻,實(shí)時獲取被研究對象的動作,姿勢,運(yùn)動,位置,表情,情緒,社會交往,人機(jī)交互等各種活動,記錄并分析其狀態(tài)與表現(xiàn)形式,形成行為-時間-頻次數(shù)據(jù)庫,記錄與編碼分析個體在活動中的行為頻次或習(xí)慣性動作的特點(diǎn)等。通過交互行為觀察,探索心理、生理的外在表現(xiàn),進(jìn)一步了解人們行為與心理反應(yīng)的相互關(guān)系。

可同步記錄多路行為視頻,記錄操作者的交互行為及實(shí)驗(yàn)環(huán)境信息支持基于移動終端的實(shí)時API編碼與事后行為半自動編碼可以按照研究目的進(jìn)行自由編碼,記錄各種行為,提高分析結(jié)果的精準(zhǔn)性支持與多模態(tài)數(shù)據(jù)同步錄制與分析行為記錄與多類型編碼

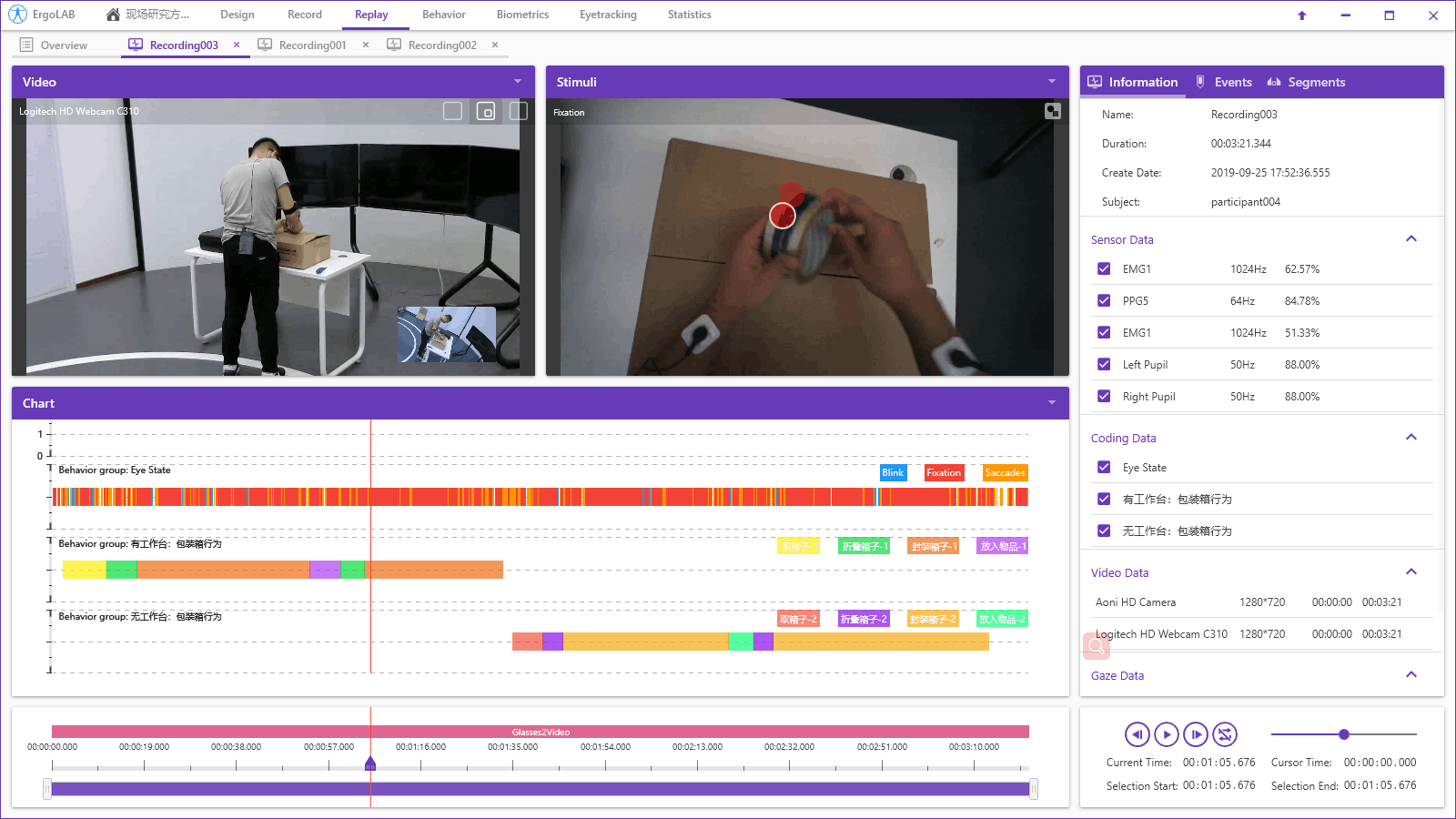

記錄模塊:主要用于記錄實(shí)驗(yàn)參與者的各種行為,支持外部設(shè)備以及多路視頻的同步采集與數(shù)據(jù)傳輸。支持在移動設(shè)備中進(jìn)行使用和數(shù)據(jù)采集。支持記錄點(diǎn)狀行為以及持續(xù)行為。視頻模塊:系統(tǒng)支持實(shí)時觀察和離線觀察方式,外部視頻源采集的多路視頻可以被兼容導(dǎo)入到觀察和分析系統(tǒng)中進(jìn)行數(shù)據(jù)編碼與統(tǒng)計。系統(tǒng)支持任意格式的視頻導(dǎo)入與播放管理。編碼模塊:系統(tǒng)包含多終端API/TTL實(shí)時行為編碼與事件標(biāo)記應(yīng)用程序,進(jìn)行實(shí)時行為編碼;支持通過鼠標(biāo)/快捷鍵等多種方式的離線半自動行為編碼。行為統(tǒng)計分析模塊

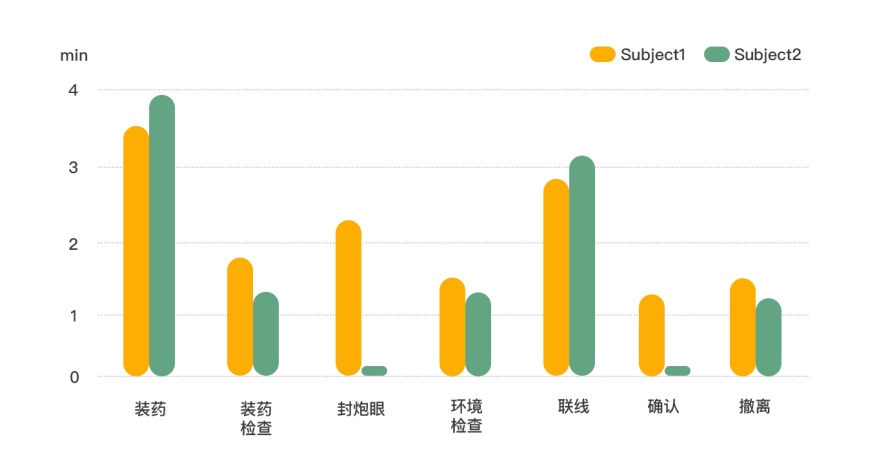

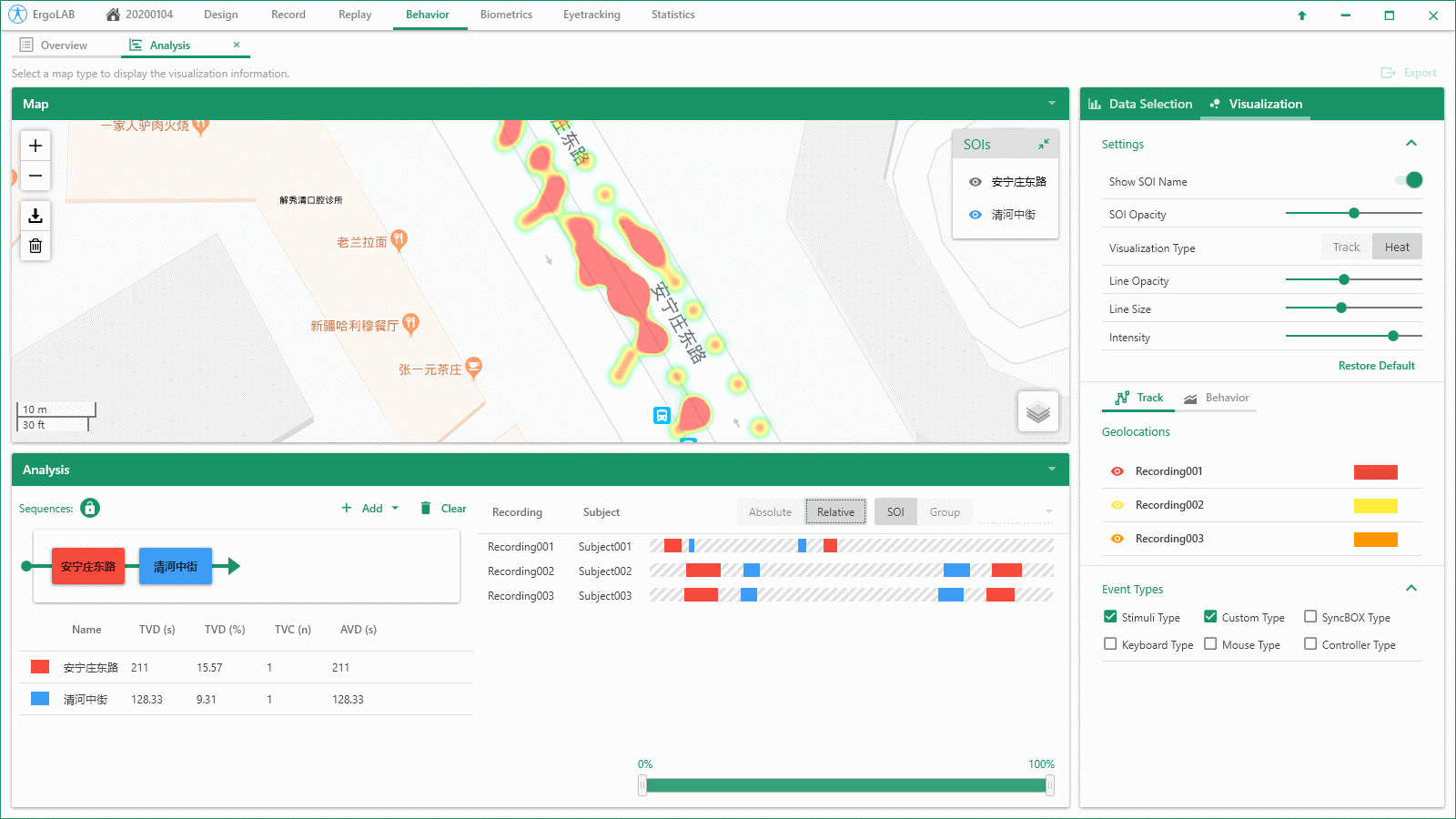

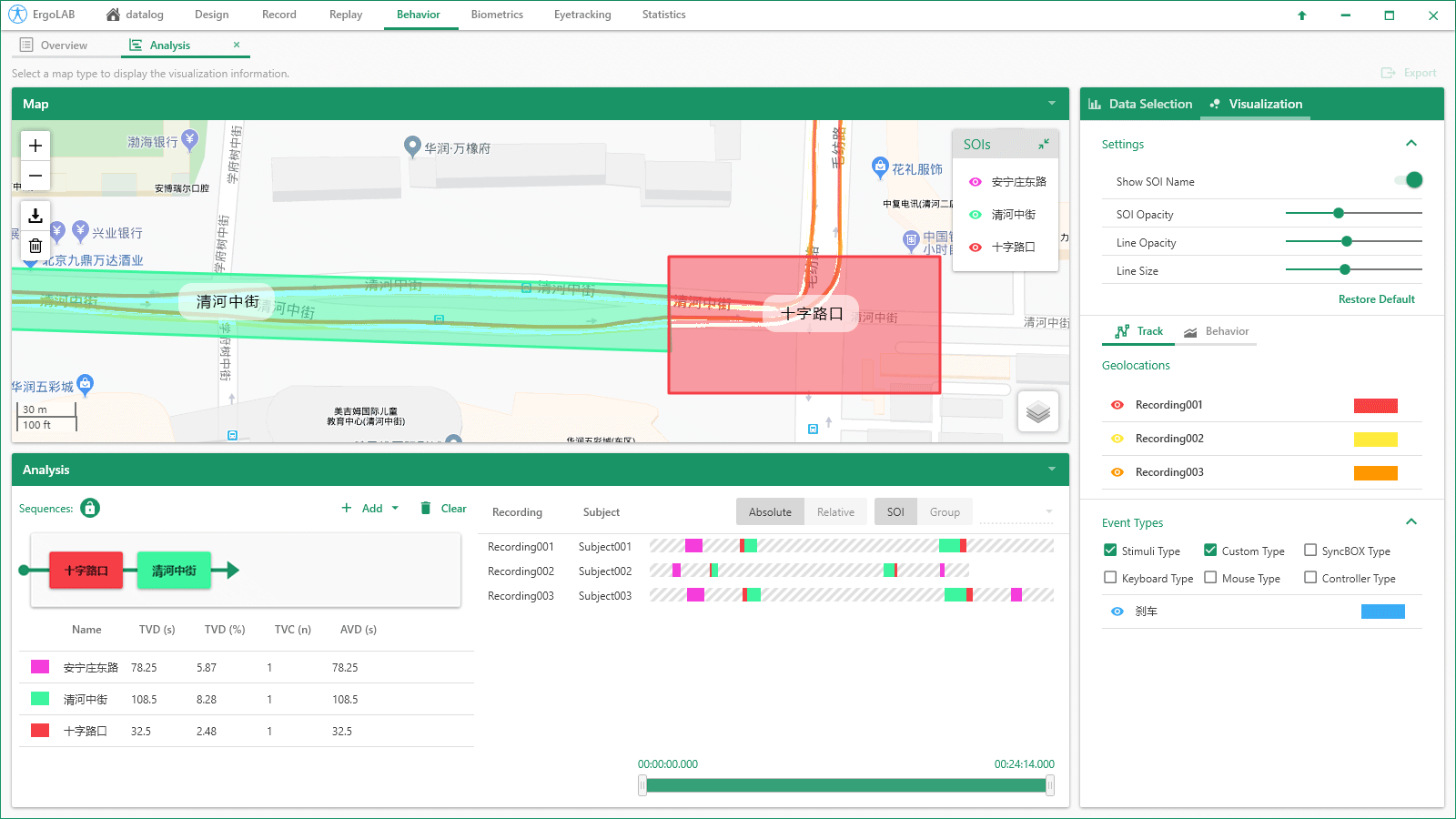

基礎(chǔ)行為統(tǒng)計:系統(tǒng)對所有編碼行為數(shù)據(jù)進(jìn)行統(tǒng)計分析,包括每種行為的第一次發(fā)生的時間、發(fā)生次數(shù)、頻率、每次發(fā)生的時間、總的持續(xù)時間、總的持續(xù)時間在全部觀察時間中所占的百分比、最短的持續(xù)時間、最長的持續(xù)時間、平均持續(xù)時間、持續(xù)時間的標(biāo)準(zhǔn)差、持續(xù)時間間隔下一區(qū)間等數(shù)據(jù)。交互行為數(shù)據(jù)分析:自動識別多種行為發(fā)生的交互關(guān)系,針對兩種或多種行為同時發(fā)生的時間、次數(shù)、概率等數(shù)據(jù)指標(biāo)進(jìn)行統(tǒng)計。支持同一時間點(diǎn)或同一時間段內(nèi)多模態(tài)數(shù)據(jù)與行為數(shù)據(jù)的交叉分析。行為順序效應(yīng)分析:支持一種行為發(fā)生在另一種行為之后/之前的多層次數(shù)據(jù)統(tǒng)計,包括行為之間的延遲效應(yīng)、順序效應(yīng)分析,并一鍵導(dǎo)出行為發(fā)生的可視化序列性分析報告。編碼行為可視化時空分析

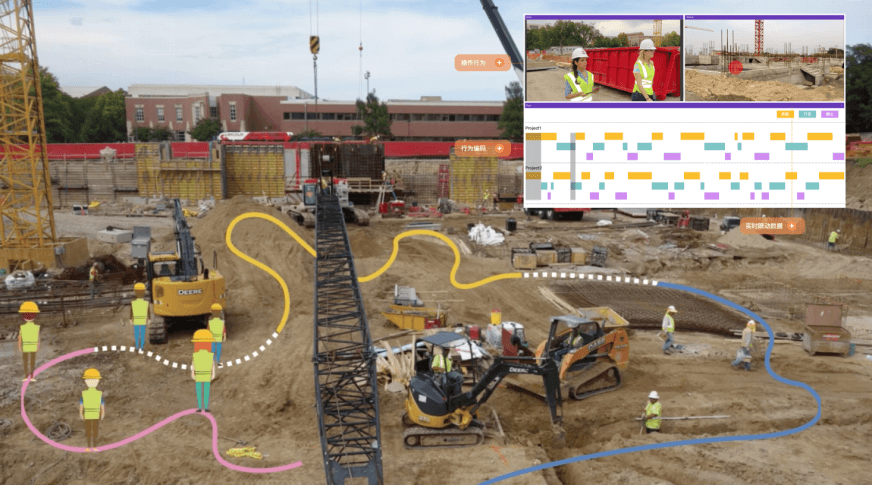

編碼行為可視化時空分析:支持所有行為編碼的數(shù)據(jù)進(jìn)入時空分析,系統(tǒng)提供不同類型的熱圖及可視化不同行為發(fā)生的時空位置關(guān)系。支持多被試的行為數(shù)據(jù)與動態(tài)時空位置的疊加分析。編碼行為時空SOI統(tǒng)計:支持自動統(tǒng)計SOI興趣區(qū)域內(nèi)的行為編碼數(shù)據(jù),統(tǒng)計指標(biāo)包括:SOI內(nèi)行為發(fā)生的次數(shù)、每分鐘發(fā)生的次數(shù)、總持續(xù)時間、最小持續(xù)時間、最大持續(xù)時間、平均持續(xù)時間等。多維度數(shù)據(jù)的交叉分析:基于多維度人機(jī)環(huán)境時空數(shù)據(jù)同步技術(shù),行為數(shù)據(jù)可以與項(xiàng)目中采集的任意數(shù)據(jù)源進(jìn)行交叉統(tǒng)計分析。如基于時間同步的眼動數(shù)據(jù)、生理數(shù)據(jù)等。實(shí)現(xiàn)時間軸數(shù)據(jù)的交集可視化以及多維度數(shù)據(jù)的綜合統(tǒng)計。ErgoLAB人機(jī)環(huán)境同步云平臺可人-機(jī)-環(huán)境多維度數(shù)據(jù)的同步采集與綜合分析,包括眼動追蹤、生理測量、生物力學(xué)、腦電、腦成像、行為、人機(jī)交互、動作姿態(tài)、面部表情、主觀評 價、時空行為、模擬器、物理環(huán)境等,為科學(xué)研究及應(yīng)用提供完整的數(shù)據(jù)指標(biāo)。平臺可完成完整的實(shí)驗(yàn)和測評流程,包括項(xiàng)目管理-試驗(yàn)設(shè)計-同步采集-信號處理-數(shù)據(jù)分析-人工智能應(yīng)用-可視化報告,支持基于云架構(gòu)技術(shù)的團(tuán)體測試和大數(shù)據(jù)云管理。

掃一掃,關(guān)注微信

掃一掃,關(guān)注微信